Los seres humanos tienen en el habla, la representación mental de las palabras y su significado, una de las características clave que les diferencian del resto de seres vivos. El cerebro, en concreto el lóbulo temporal, aloja lo esencial del sistema auditivo humano. En él, diferentes grupos neuronales descomponen los estímulos que llegan desde el oído, analizando la frecuencia, el ritmo, la velocidad o el orden de las sílabas en un proceso tan complejo que le costó al hombre miles de años de evolución. Ahora, un grupo de científicos ha conseguido descodificar esa actividad cerebral y convertirla en palabras. Aún queda mucho por hacer, pero el camino para leer la mente ya se ha abierto.

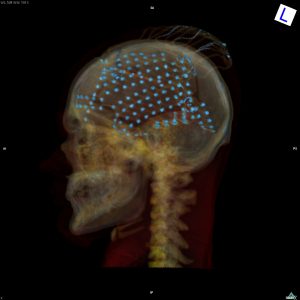

Investigadores de varias universidades estadounidenses han tenido la oportunidad de colocar 256 sensores sobre el córtex cerebral de 15 enfermos de epilepsia o cáncer cerebral. La lectura de las ondas cerebrales en humanos se suele hacer con electrodos sobre la cabeza, pero el cráneo resta fiabilidad a las pruebas. Ellos, sin embargo, contaron con voluntarios a los que había que abrirles y dejar el cerebro al descubierto para poder tratar su afección. Los científicos aprovecharon para registrar la actividad cerebral de su lóbulo temporal mientras oían una serie de palabras. Los experimentos con cada uno no fueron más allá de 5 o 10 minutos pero los investigadores obtuvieron una serie de espectogramas que les ayudaron, mediante un proceso de inversión, a establecer una relación entre una determinada actividad cerebral y el sonido de una palabra.

"Buscamos en qué zonas corticales aumentaba la actividad ante determinadas frecuencias acústicas y, desde ahí, mapeamos de nuevo el sonido", explica en un comunicado de la Universidad de Berkeley California uno de los autores del experimento, Brian Pasley. Compara su técnica con la de un pianista que conoce los sonidos de las teclas tan bien que puede ver las teclas que otro pianista está tocando en una habitación insonorizada e imaginar la música, como hacía un tal Ludwig van Beethoven ya víctima de la sordera.

Pasley probó dos modelos computacionales diferentes para comparar los sonidos hablados con el patrón de actividad en los electrodos. Los pacientes oían una palabra y los modelos debían predecirla basándose en los registros de los electrodos. El mejor de los dos métodos fue capaz de reproducir el sonido tan cercano a la palabra original que Pasley y sus colegas investigadores podían adivinar correctamente las palabras. Fueron entrenando este algoritmo comparando el espectograma de la actividad neuronal con el del sonido de distintas palabras hasta conseguir afinarlo. Con un segundo programa similar a un sintetizador de sonido, reproducían los espectrogramas. Como se puede comprobar en los archivos de audio, las voces realmente oídas y las recreadas por el cerebro son similares. Los investigadores creen que con más tiempo podrían ajustar aún más su sistema.

"Esta investigación es un gran paso hacia la comprensión de qué características del habla son representadas en el cerebro humano", asegura el profesor de psicología y neurociencia de la misma universidad y coautor del trabajo, Robert Knight. "El análisis de Brian puede reproducir el sonido que ha oído el paciente y en realidad se puede reconocer la palabra, aunque no a la perfección", añade. Este investigador defiende que este descubrimiento podrá ser aplicado a las verbalizaciones mentales ya que anteriores estudios han demostrado que a las personas que se les pedía que pensaran en una palabra activaban las mismas regiones cerebrales que si la pronunciaban realmente.

Una limitación evidente de este trabajo en el que han participado neurocientíficos, psicólogos e ingenieros es que han conseguido reproducir palabras que oye el paciente y que este representa mentalmente. No han registrado y descodificado sus propios pensamientos o palabras que quisiera comunicar. Pero la investigación tampoco lo pretendía.

Por supuesto este estudio, publicado en la presente edición de PLoS Biology, es sólo un pequeño paso. Pero también lo fueron, hace una década, los primeros trabajos sobre el control mental del movimiento. Hoy, muchos enfermos o accidentados pueden interactuar con ordenadores y otros aparatos con sólo pensarlo. "Pero ese trabajo, sin ser fácil, es relativamente simple en comparación con el de la reconstrucción del lenguaje", recuerda Knight.

Lo que sí hace esta investigación es abrir un camino para que, en el futuro, las personas que por cualquier razón no puedan verbalizar sus pensamientos consigan comunicarse con los demás a través de las máquinas. Quien sabe si los enfermos en coma podrán algún día expresar lo que piensan. La preocupación por el posible riesgo que abre la ciencia a la telepatía, de que se pueda leer la mente o lleguemos a un oscuro escenario dominado por el control mental habrá que dejarla por ahora para las películas y series de ciencia ficción.

A ver Editor, Beethoven no es un «TAL» No es cualquier personaje como para llamarle TAL saludos

Hay personas que tienen desarrolladas ese control mental no es una siencia ficcion reflexionar sin hablar y la mente habla sin pronunciar letras,que al final se realiza aeiou oformar una palabra o contesto amilies de kilometros